Dreambooth google colab

Mam nadzieję, że artykuł będzie interesujący dreambooth google colab tylko dla profesjonalistów związanych z technologiami AI, ale także dla artystów, grafików, developerów gier, a także dla każdej osoby pasjonującej się rozwiązaniami technologicznymi.

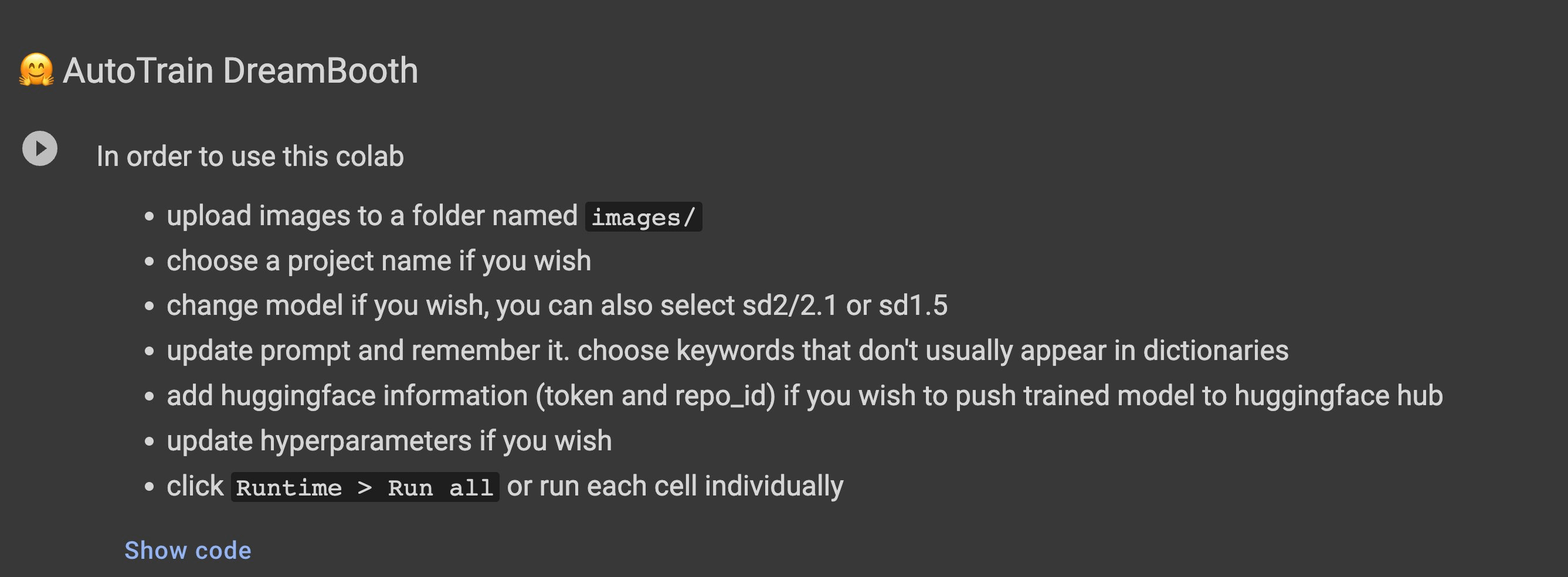

Skip to content. Automatic Artificial Intelligence - AI Tools. Google Colab Generative Art. Colab automatic webui and Dreambooth adjustment, train your model using this easy, simple and fast colab. Just enter your Huggingface token only once, and he will delete all files in Gdrive, including a trained model that you can use directly from Colab. Remember to use high quality reference photos for training.

Dreambooth google colab

Duże modele zamiany tekstu na obraz poczyniły znaczący postęp w rozwoju sztucznej inteligencji, wytwarzając wysokiej jakości i zróżnicowaną syntezę obrazu z danego monitu tekstowego. Modele te nie są w stanie zsyntetyzować unikalnych reprezentacji przedmiotów w różnych ustawieniach ani odtworzyć wyglądu obiektów w danym zestawie odniesienia. Nowo wydane technologie, takie jak DALL. Nadszedł czas, aby dostosować wyniki. Ale jak? Nadeszła sztuczna inteligencja Google DreamBooth. DreamBooth ma możliwość rozpoznania tematu obrazu, dekonstrukcji go z oryginalnego kontekstu, a następnie precyzyjnej syntezy w nowy pożądany kontekst. Dodatkowo może być używany z obecnymi generatorami obrazów AI. W tym artykule przyjrzymy się dokładnie DreamBooth, jego użyciu, samouczkowi, jego ograniczeniom i wielu innym. Wymarzona budka , zupełnie nowy model rozpowszechniania tekstu na obraz, został zaprezentowany przez Google. Pisemna zachęta może być wykorzystana przez Google DreamBooth AI jako wskazówka do wygenerowania szerokiej gamy zdjęć wybranego przez użytkownika tematu w różnych ustawieniach. Grupa badawcza z Boston University i Google opracowała DreamBooth, najnowocześniejszą technikę zmiany modeli tekstu na obraz, które przeszły intensywne szkolenie wstępne.

Jak się za chwilę przekonamy dużo zależy od próbkownika.

Trwający rok to dla sztucznej inteligencji ogromny skok i rozwój. Dzięki AI możliwe jest już przetwarzanie tekstu na obraz , a nawet tekstu na wideo. Choć technik jest wiele, najczęściej wykorzystywanym modelem stosowanym do przetwarzania tekstu na obraz jest użycie tzw. Stabilną dyfuzją nazywa się najbardziej nowoczesny i najczęściej używany model uczenia maszyn poprzez tworzenie sztucznej inteligencji, który obecnie pozwala już na przetworzenie tekstu na obraz na podstawie dużej liczby zdjęć i tekstu. Ta stabilna dyfuzja wykorzystuje proces dyfuzji do generowania obrazu, które zbliżone są do tekstu. W oparciu o już stworzone aplikacje i usługi, jak Google Colab oraz DreamBooth, możliwe jest wytworzenie obrazów w oparciu o wykonany zestaw zdjęć oraz tekst. Na podstawie tekstowego opisu algorytm programu sztucznej inteligencji dochodzi do wygenerowania obrazu.

Dreambooth is a way to put anything — your loved one, your dog, your favorite toy — into a Stable Diffusion model. We will introduce what Dreambooth is, how it works, and how to perform the training. This tutorial is aimed at people who have used Stable Diffusion but have not used Dreambooth before. You will follow the step-by-step guide to prepare your training images and use our easy 1-click Colab notebook for dreambooth training. No coding is required! You can put real-life objects or persons into a Stable Diffusion model and generate images in different styles and settings.

Dreambooth google colab

No installation is needed! DreamBooth is a subject-driven AI generation model that fine-tunes the results of text-to-image diffusion models or new images. E 2, Midjourney, and Stable Diffusion have a lack of contextualization of the subject.

Essential craftsman spec house

Skoro ta sama kombinacja seed i prompt daje ten sam obraz za każdym razem, możemy wykorzystać tę właściwość na wiele sposobów, np. Poprzednie dwa obrazy były wygenerowane przy użyciu 20 kroków. Musisz ograniczyć swoją uwagę do dwóch pól wejściowych. Modele te nie są w stanie zsyntetyzować unikalnych reprezentacji przedmiotów w różnych ustawieniach ani odtworzyć wyglądu obiektów w danym zestawie odniesienia. Po zakończeniu kliknij ustawienia w prawym górnym rogu. To zadanie różni się w szczególności od przeniesienia stylu, które zachowuje semantykę sceny źródłowej, jednocześnie włączając styl innego obrazu do oryginalnej sceny. Wszystkie obrazy w tej części artykułu były generowane na tym samym ziarnie: Ta stabilna dyfuzja wykorzystuje proces dyfuzji do generowania obrazu, które zbliżone są do tekstu. Twój adres e-mail nie zostanie opublikowany. Development na miękko 27 listopada W pierwszym etapie dodawane jest coraz więcej szumu do wyjściowej próbki danych, zbliżając je do postaci isotropowej. Przechowywanie lub dostęp techniczny jest niezbędny do uzasadnionego celu przechowywania preferencji, o które nie prosi subskrybent lub użytkownik. Aktualności i wydarzenia z Sii Event. Przed wprowadzeniem modeli dyfuzji do generowania obrazów stosowano generatywne sieci przeciwnych ang.

For example, you can generate images with yourself or a loved one as a popular video game character, as a fantastical creature, or just about anything you can think of — you can generate a sketch or a painting of your pet as a dragon or as the Emperor of Mankind. Google Colab is a cloud service offered by Google, and it has a generous free tier.

Po zakończeniu kliknij ustawienia w prawym górnym rogu. Korzystając z powyższych metod, użytkownicy końcowi mogą zastosować proces fine-tuning w celu dostosowania modelu Stable Diffusion do ich specyficznych potrzeb i uzyskania lepszych rezultatów zależnie od przeznaczenia. Składają się one z generatora i dyskryminatora, które współpracują ze sobą, by uzyskać jak najlepszy efekt. Pierwszym krokiem jest ustalenie, jakie rodzaje procesorów graficznych i pamięci VRAM są dostępne. Przejdź do głównej zawartości Przejdź do prawej nawigacji nagłówka Przejdź do stopki witryny. Nowo wydane technologie, takie jak DALL. W celu przeciwdziałania ograniczeniom wynikającym z początkowego treningu modelu między innymi wspomniane wcześniej karykaturalne twarze, dłonie czy zęby , użytkownicy końcowi mogą zdecydować się na dodatkowe szkolenie w celu doprecyzowania wygenerowanych obrazów do bardziej konkretnych przypadków użycia. Jestem inżynierem informatyki, interesuję się sztuczną inteligencją i pracowałem przy projektach badawczych w startupach. Jeśli chcesz subskrybować bloga w języku angielskim, proszę zmień wersję językową strony. Początkowo modele dyfuzji, które powstały w roku, były szkolone tak, aby usuwały szum z obrazów szkoleniowych. Dlaczego Sii. Domyślnie używamy 25 kroków, co powinno wystarczyć do generowania dowolnego rodzaju obrazu.

I apologise, but, in my opinion, you are not right. I can defend the position. Write to me in PM, we will communicate.

In my opinion you are not right. I am assured. I can prove it. Write to me in PM.